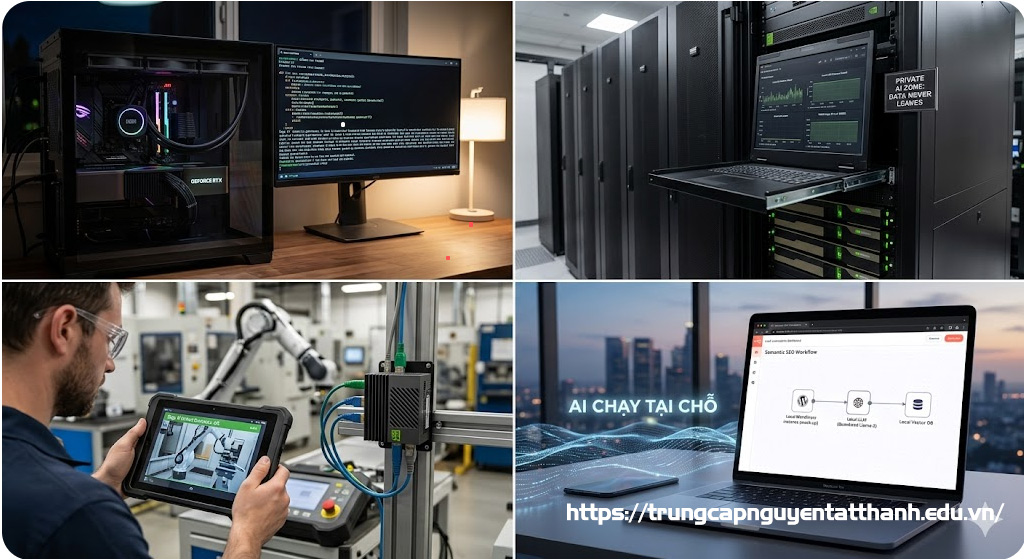

Xu Hướng Local LLM & Edge AI: Tương Lai Của Trí Tuệ Nhân Tạo Chạy Tại Chỗ

Trong kỷ nguyên bùng nổ của trí tuệ nhân tạo, việc phụ thuộc hoàn toàn vào các dịch vụ Cloud AI (như OpenAI hay Gemini) đang bộc lộ những rào cản về chi phí và bảo mật. Năm 2026 đánh dấu bước chuyển mình mạnh mẽ sang Local LLM (Mô hình ngôn ngữ lớn chạy tại chỗ) và Edge AI. Vậy tại sao xu hướng này lại trở thành “chìa khóa vàng” cho cả cá nhân và doanh nghiệp?

1. Local LLM và Edge AI là gì?

Local LLM là việc vận hành các mô hình ngôn ngữ lớn trực tiếp trên phần cứng cá nhân hoặc máy chủ nội bộ thay vì gửi dữ liệu lên đám mây.

Edge AI (AI cạnh) đưa khả năng xử lý của trí tuệ nhân tạo đến gần nơi dữ liệu được tạo ra nhất (thiết bị IoT, điện thoại, máy tính cá nhân). Sự kết hợp này tạo ra một hệ thống AI độc lập, tốc độ cao và cực kỳ riêng tư.

2. Tại sao doanh nghiệp nên chuyển sang AI chạy tại chỗ?

Bảo mật dữ liệu tuyệt đối

Với Local LLM, mọi thông tin nhạy cảm như chiến lược kinh doanh, mã nguồn phần mềm hay dữ liệu khách hàng đều nằm trong hạ tầng nội bộ. Điều này giúp loại bỏ hoàn toàn nguy cơ rò rỉ thông tin qua các API bên thứ ba.

Tối ưu hóa chi phí vận hành (OpEx)

Thay vì trả phí thuê bao hàng tháng hoặc phí theo số lượng token (pay-per-token) đắt đỏ, doanh nghiệp chỉ cần đầu tư phần cứng một lần. Đối với các tác vụ lặp đi lặp lại với tần suất lớn, Local LLM giúp tiết kiệm hàng ngàn USD mỗi năm.

> Bài viết liên quan: Quản Trị AI 2026: Khi “Hộp Đen” Thuật Toán Buộc Phải Công Khai Danh Tính

Khả năng hoạt động ngoại tuyến (Offline)

Edge AI cho phép các hệ thống điều khiển, phân tích dữ liệu hoạt động ổn định ngay cả khi không có kết nối internet, đảm bảo tính liên tục cho các quy trình sản xuất và dịch vụ.

3. Cấu hình phần cứng tối ưu để chạy Local LLM năm 2026

Để vận hành mượt mà các mô hình như Llama 4 hoặc Mistral phiên bản mới, cấu hình phần cứng đóng vai trò quyết định.

-

GPU (Quan trọng nhất): Card đồ họa có VRAM lớn là ưu tiên hàng đầu. Các dòng RTX 3060 (12GB) hoặc RTX 4060 Ti (16GB) hiện là lựa chọn “quốc dân” cho cá nhân. Với doanh nghiệp, các dòng RTX 4090 hoặc card chuyên dụng như A6000 là cần thiết.

-

RAM: Tối thiểu 32GB để hỗ trợ quá trình tải mô hình và xử lý dữ liệu đệm.

-

Lưu trữ: Ổ cứng SSD NVMe tốc độ cao để giảm thời gian load mô hình (Model loading time).

Mẹo kỹ thuật: Sử dụng kỹ thuật Quantization (định lượng hóa 4-bit hoặc 8-bit) giúp bạn chạy được các mô hình lớn trên các dòng card đồ họa có VRAM khiêm tốn mà vẫn giữ được 90-95% độ chính xác.

4. Các công cụ hỗ trợ triển khai Local AI phổ biến

Nếu bạn đang bắt đầu xây dựng hệ thống AI tại chỗ, đừng bỏ qua các nền tảng sau:

-

Ollama: Công cụ đơn giản nhất để chạy LLM trên macOS, Linux và Windows.

-

LocalAI: Cung cấp API tương thích hoàn toàn với OpenAI, giúp bạn thay thế Cloud AI vào các ứng dụng có sẵn một cách dễ dàng.

-

LM Studio: Giao diện trực quan để tìm kiếm, tải và thử nghiệm các mô hình từ Hugging Face.

-

vLLM: Thư viện tối ưu hóa hiệu suất cực cao cho việc triển khai mô hình trên máy chủ doanh nghiệp.

5. Tương lai của Edge AI và Local LLM

Xu hướng “AI hóa” thiết bị đầu cuối đang diễn ra mạnh mẽ. Từ những chiếc gương thông minh, hệ thống camera an ninh đến các phần mềm quản trị nội bộ đều sẽ tích hợp sẵn các mô hình AI nhỏ gọn nhưng thông minh. Việc làm chủ công nghệ Local LLM không chỉ là một lợi thế kỹ thuật, mà còn là một chiến lược sống còn để bảo vệ chủ quyền dữ liệu trong tương lai số.