Năm 2026, cụm từ “cháy hàng” không còn dành cho những chiếc card đồ họa xa xỉ, mà dành cho những thanh RAM và chip nhớ HBM. Khi các mô hình trí tuệ nhân tạo như Gemini 3 hay GPT-5 chuyển mình sang trạng thái tự vận hành (Agentic AI), nhu cầu về bộ nhớ đã vượt xa khả năng cung ứng của toàn ngành bán dẫn toàn cầu.

1. AI Datacenter: “Kẻ hủy diệt” nguồn cung DRAM

Trong năm 2026, các trung tâm dữ liệu AI dự kiến sẽ tiêu thụ tới 70% sản lượng DRAM toàn cầu. Đây là một cú sốc lớn đối với thị trường thiết bị tiêu dùng.

-

Sự ưu tiên tuyệt đối: Ba gã khổng lồ Samsung, SK Hynix và Micron đã gần như bán sạch công suất sản xuất bộ nhớ băng thông cao (HBM4) cho đến hết năm 2026. Các hợp đồng dài hạn từ OpenAI, Microsoft và Nvidia đã khóa chặt nguồn cung, khiến các nhà sản xuất smartphone và PC chỉ còn biết “nhìn nhau”.

-

Hệ quả giá thành: Theo báo cáo từ TrendForce vào tháng 3/2026, giá hợp đồng DRAM đã tăng 95% chỉ trong quý I. Tại các thị trường ngách, giá chip nhớ đang được định giá theo giờ, biến linh kiện điện tử thành một loại “hàng hóa phái sinh” đầy biến động.

2. Điểm nghẽn kỹ thuật: Khi GPU mạnh nhưng “không có chỗ để nhớ”

Dù Nvidia đã ra mắt các dòng chip Blackwell thế hệ mới với hiệu năng tính toán khủng khiếp, nhưng rào cản lớn nhất lại nằm ở băng thông bộ nhớ.

-

Tỷ lệ vàng bị phá vỡ: Các mô hình AI hiện đại đòi hỏi dung lượng VRAM khổng lồ để duy trì khả năng suy luận thời gian thực. Việc thiếu hụt chip nhớ đã buộc Nvidia phải cắt giảm 30-40% sản lượng GPU chơi game trong nửa đầu năm 2026 để ưu tiên tài nguyên cho mảng Enterprise.

-

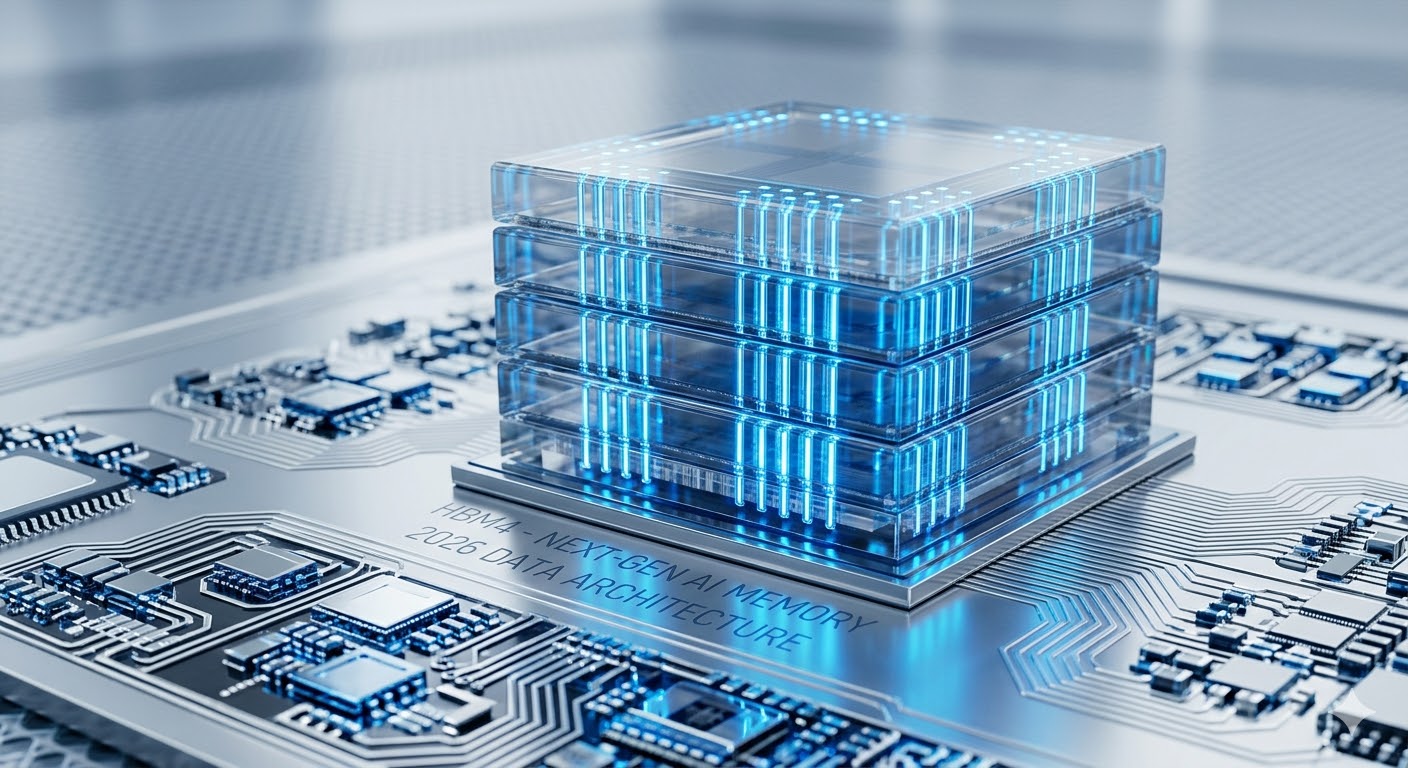

Sự trỗi dậy của HBM4: Năm 2026 đánh dấu sự xuất hiện của HBM4 với kiến trúc 16 tầng chồng khít. Tuy nhiên, tỷ lệ xuất xưởng (yield rate) của dòng chip này vẫn là một thách thức lớn, khiến tình trạng khan hiếm càng thêm trầm trọng.

3. Hạ tầng năng lượng: Từ làm mát không khí sang làm mát bằng chất lỏng

“Cơn khát” hạ tầng 2026 không chỉ dừng lại ở linh kiện, mà còn ở điện và nhiệt. Các trung tâm dữ liệu AI hiện nay đang tiêu thụ lượng điện tương đương với các quốc gia tầm trung.

-

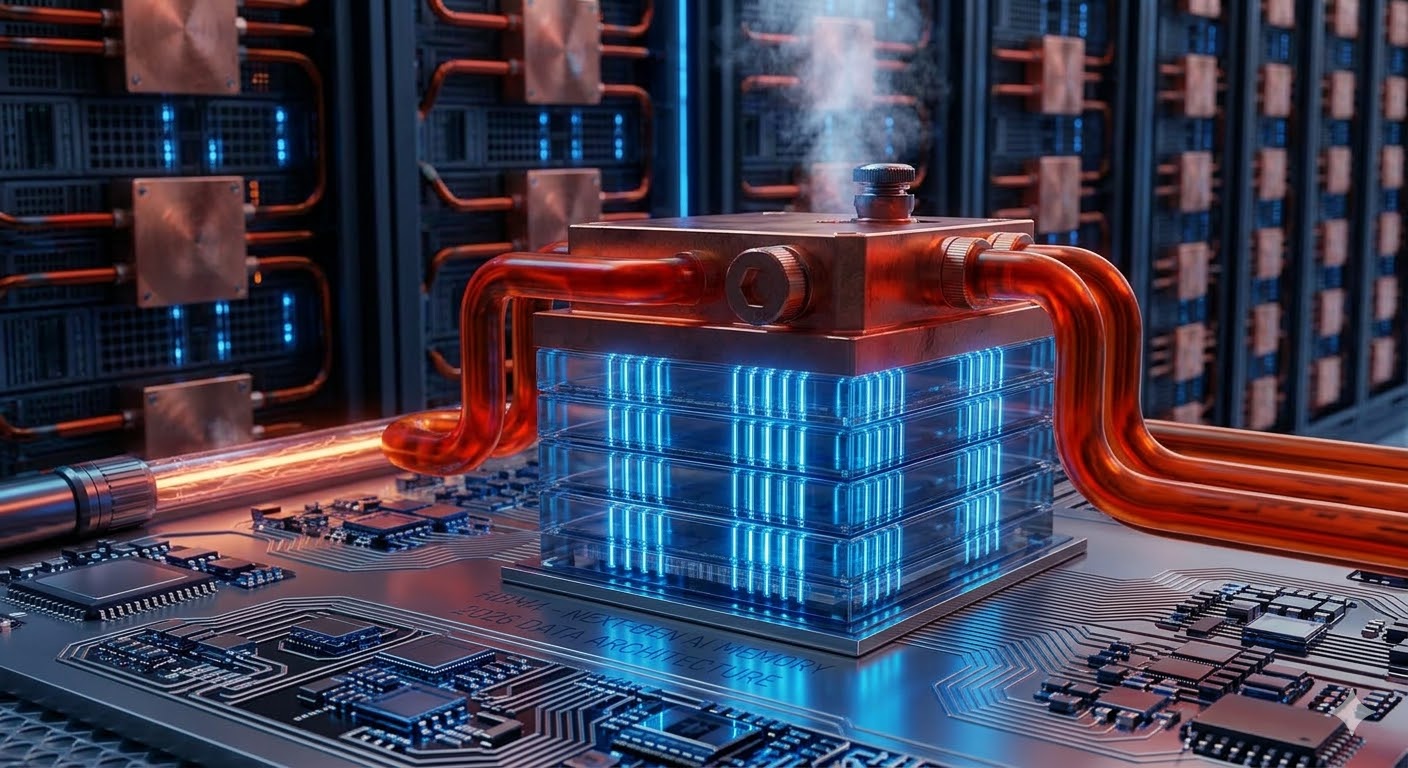

Kỷ nguyên Liquid Cooling: Khi mật độ công suất mỗi rack máy chủ vượt ngưỡng 50-70 kW, công nghệ làm mát bằng không khí truyền thống chính thức “nghỉ hưu”. Năm 2026, làm mát bằng chất lỏng trực tiếp (Direct-to-chip) đã trở thành tiêu chuẩn bắt buộc cho mọi hạ tầng AI mới.

-

Tìm kiếm nguồn năng lượng sạch: Để duy trì vận hành, các Big Tech đang chạy đua đầu tư vào Lò phản ứng hạt nhân module nhỏ (SMR). Năng lượng giờ đây là “đồng tiền” mới trong cuộc đua AI.

4. Tác động đến người tiêu dùng: Laptop 8GB RAM trở thành “đồ cổ”

Nếu bạn định mua một chiếc laptop hay smartphone vào giữa năm 2026, hãy chuẩn bị tinh thần cho mức giá cao hơn ít nhất 20-30%.

-

Thị trường PC co lại: IDC dự báo thị trường PC toàn cầu có thể sụt giảm 9% do chi phí linh kiện tăng vọt. Các hãng sản xuất đang phải lựa chọn giữa việc tăng giá bán hoặc cắt giảm dung lượng bộ nhớ trên các dòng máy phổ thông.

-

Smartphone “thiếu máu”: Các tính năng AI tích hợp trên điện thoại (On-device AI) đòi hỏi tối thiểu 12GB – 16GB RAM để hoạt động mượt mà, nhưng sự khan hiếm DRAM đang khiến các mẫu flagship trở nên đắt đỏ hơn bao giờ hết.

Kết luận: Lối thoát nào cho năm 2027?

Cuộc khủng hoảng bộ nhớ 2026 là một “điểm điều chỉnh” cần thiết của thị trường. Nó buộc các nhà phát triển AI phải tối ưu hóa thuật toán để chạy trên phần cứng hạn chế hơn, thay vì chỉ dựa vào việc tăng quy mô hạ tầng.

Dự kiến, tình trạng căng thẳng sẽ chỉ bắt đầu hạ nhiệt vào cuối năm 2027 khi các nhà máy mới tại Mỹ và Nhật Bản của Micron và Samsung đi vào hoạt động ổn định.

> Xem thêm: Tối Ưu Hóa Bộ Máy Với AI Trong Hành Chính Và Quản Trị Doanh Nghiệp